Redis часто произносят слишком небрежно: “добавим кэш”, “поставим Redis”, “уберём нагрузку с базы”. На этом уровне он звучит как бесплатное ускорение без побочных эффектов. На практике всё сложнее: Redis действительно умеет резко снизить latency и разгрузить основную БД, но точно так же может привнести новую точку отказа, проблемы с консистентностью, горячие ключи, неочевидную деградацию под памятью и больше операционной сложности, чем пользы.

Здесь не про все команды Redis и не про экзотические возможности, а про то, как на него смотреть инженерно: когда он уместен, какие сценарии типичны, какие анти-паттерны встречаются чаще всего, чего ждать по порядку величин, и почему фразы “у нас есть кэш” почти никогда недостаточно для реального design review.

В статье

- Что это за класс решений и зачем он нужен

- Когда Redis обычно нужен

- Где Redis действительно помогает

- Почему “просто поставим кэш” — опасная формулировка

- Анти-паттерны и типовые ошибки

- Что важно при подключении Redis-клиента

- TTL, память и вытеснение: важные особенности Redis

- Latency, throughput и размеры данных: какие порядки величин ожидать

- Надёжность, persistence, failover и масштабирование

- Ограничения Redis, которые важно знать заранее

- Короткий checklist перед внедрением

Что это за класс решений и зачем он нужен

Redis — это in-memory data store. Официальная документация прямо описывает его как in-memory data store, который может использоваться как cache, streaming engine, message broker и не только.

С инженерной точки зрения это значит следующее:

- Redis держит рабочий набор данных в памяти;

- у него очень дешёвые по latency операции для типовых access patterns;

- он умеет не только

GET/SET, но и структуры данных:hash,list,set,sorted set,streamи другие; - у него есть replication, persistence и разные режимы high availability, но это не делает его автоматически “ещё одной PostgreSQL”.

Обычно Redis нужен не потому, что “он быстрый”, а потому что у него есть один из следующих профилей:

- Нужен очень быстрый доступ к горячим данным.

- Нужны counters, rate limits, TTL и простые атомарные операции.

- Нужна быстрая работа с ephemeral state: session, token, флаг, lock, short-lived aggregate.

- Нужен простой broker-ish слой или stream processing без тяжёлой платформы вокруг.

Там, где рабочая модель действительно похожа на “горячее состояние + быстрые операции + контролируемая потеря точности или времени жизни”, Redis попадает очень хорошо.

Когда Redis обычно нужен

Если отбросить маркетинговый шум, Redis чаще всего оказывается полезен в нескольких очень понятных ситуациях:

- есть горячие данные, которые читают намного чаще, чем меняют;

- нужны TTL, rate limit, counters и другие дешёвые атомарные операции;

- есть короткоживущее состояние: session, token metadata, одноразовые коды, временные флаги;

- нужна простая внутренняя очередь или stream без полноценной событийной платформы;

- нужны ranking и score-based выборки, где

sorted setестественно ложится на задачу.

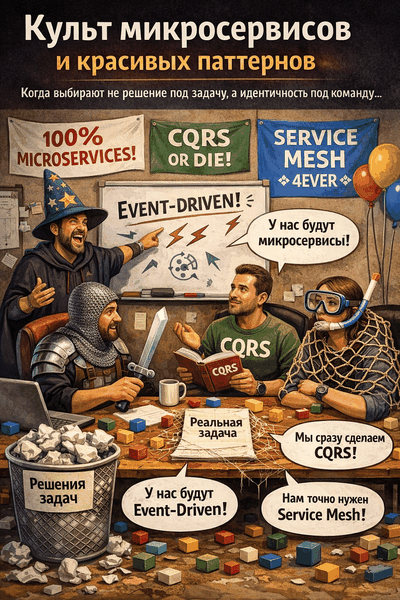

Если же от Redis ждут, что он одновременно ускорит чтения, станет постоянным хранилищем, решит event-driven integration и заменит очереди, это уже тревожный сигнал. Обычно в этом месте проблема не в том, что “не выбрали правильный Redis”, а в том, что в одну систему пытаются сложить сразу несколько разных ролей.

Где Redis действительно помогает

1. Cache-aside для дорогих чтений

Это самый частый и самый полезный сценарий:

- приложение читает данные из Redis;

- при

missидёт в основную БД или внешний API; - складывает результат в Redis с TTL;

- дальше обслуживает повторные чтения из памяти.

flowchart LR

A["Клиент"] --> B["Приложение"]

B --> C{"Ключ есть в Redis?"}

C -->|Да| D["Ответ из Redis"]

C -->|Нет| E["Чтение из основной БД"]

E --> F["Сохранить в Redis с TTL"]

F --> G["Вернуть ответ клиенту"]

D --> G

Хорошо работает для:

- карточек объектов;

- справочников;

- агрегированных DTO;

- результатов тяжёлых запросов;

- metadata и feature flags.

2. Session store и короткоживущие токены

Redis хорошо подходит для:

- web-session;

- access token metadata;

- одноразовых кодов;

- rate-limit buckets;

- временных флагов.

Здесь особенно полезны TTL и атомарные операции.

3. Counters, quotas, rate limiting

Один из самых естественных сценариев Redis:

INCR/INCRBY;- sliding window или fixed window rate limit;

- квоты на пользователя, API key или tenant;

- дедупликация коротких повторов.

Это намного естественнее для Redis, чем пытаться делать то же самое через тяжёлую transactional DB на каждый запрос.

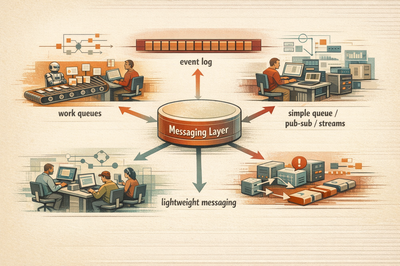

4. Очереди и стримы для простых внутренних сценариев

Через LIST или STREAM Redis часто используют для:

- фоновых задач;

- коротких pipelines;

- внутренней доставки событий;

- consumer groups без отдельного Kafka/RabbitMQ-слоя.

Но именно здесь особенно важно не перепутать “простая очередь для внутренней задачи” и “полноценная событийная платформа”.

5. Leaderboards, ranking, score-based выборки

sorted set — очень сильная сторона Redis:

- рейтинги;

- топы;

- score-based диапазоны;

- приоритетные выборки.

Это как раз тот класс задач, где Redis может быть не просто cache, а самым естественным движком данных.

Почему “просто поставим кэш” — опасная формулировка

Фраза “используем кэш и Redis” обычно скрывает несколько неотвеченных вопросов:

- Что будет source of truth?

- Как происходит invalidation?

- Что происходит на cache miss?

- Что будет, если Redis недоступен?

- Можно ли обслужить запрос без него?

- Какой TTL и почему именно такой?

- Что будет при cold start или после flush?

Именно поэтому “добавили Redis” не равно “ускорили систему”.

На практике Redis добавляет:

- ещё одно сетевое соединение в request path;

- ещё одну точку деградации;

- ещё один тип state, за который нужно отвечать;

- ещё одну operational surface: память, eviction, persistence, replication, failover.

flowchart TD

A["Идея: добавить Redis"] --> B{"Сервис может жить без Redis?"}

B -->|Да| C["Это ускоряющий слой: cache / counters / ephemeral state"]

B -->|Нет| D["Это уже critical dependency"]

C --> E{"Есть TTL, invalidation и cold-start стратегия?"}

E -->|Да| F["Хороший кандидат"]

E -->|Нет| G["Высокий риск stale data, stampede и неочевидной деградации"]

D --> H{"Продуманы persistence, failover и деградация?"}

H -->|Да| I["Нормальный stateful tier"]

H -->|Нет| J["Redis принесёт больше проблем, чем пользы"]

Если ответ на вопрос “что будет без Redis” звучит как “сервис по сути не может работать”, значит вы, скорее всего, внедряете не просто cache, а новую критичную зависимость. И к ней надо относиться как к полноценной БД или middleware, а не как к “маленькому ускорителю”.

Что обычно идёт не так

Типичный неудачный сценарий выглядит так:

- Redis ставят “для ускорения”.

- В него начинают складывать всё подряд.

- TTL и invalidation определяются по ощущению.

- Через время оказывается, что без Redis система не держит нагрузку.

- После этого Redis уже нельзя убрать, но и эксплуатационно он не был спроектирован как критичная зависимость.

То есть команда думала, что добавляет cache, а на деле добавила новый stateful tier.

Анти-паттерны и типовые ошибки

1. Кэшировать без явной стратегии invalidation

Самая популярная ошибка — сложить данные в Redis и считать, что TTL сам всё решит.

Если данные меняются часто, а stale-data неприемлемы, одних TTL обычно недостаточно.

Нужно заранее понимать:

- кто инвалидирует ключ;

- когда это происходит;

- допустимы ли устаревшие данные;

- сколько времени stale-copy может жить.

2. Делать Redis обязательным для каждого запроса без degrade strategy

Если Redis недоступен, приложение должно:

- либо уметь обойтись без него;

- либо честно считаться завязанным на отдельный critical dependency.

“Без Redis всё упало, потому что это же всего лишь кэш” — плохой архитектурный сюрприз.

3. Складывать в Redis огромные объекты

Redis любит небольшие и часто используемые значения лучше, чем большие blobs.

Практическое правило:

- десятки байт, сотни байт, килобайты — нормальный рабочий диапазон;

- сотни килобайт и мегабайты на значение — уже повод пересмотреть design.

Большие значения бьют сразу по:

- RAM;

- сети;

- сериализации;

- репликации;

- latency хвостов.

4. Хранить в Redis “всё временное”, но без границ роста

Особенно опасно для:

stream;- очередей;

- session store;

- дедупликационных ключей;

- служебных множеств и индексов.

Если нет TTL, retention или явной уборки, Redis очень быстро превращается из “быстрого слоя” в память, которая бесконтрольно ест RAM.

5. Не думать про hot keys

Один особенно популярный ключ или небольшой набор ключей может:

- перегреть один shard;

- создать неравномерную нагрузку;

- сделать cluster “формально масштабированным”, но practically skewed.

6. Использовать Redis как primary database по умолчанию

Иногда это оправдано. Но фраза “Redis же тоже база данных” слишком часто используется как shortcut для решения, которое на самом деле требует:

- отдельной модели durability;

- отдельной модели backup;

- понимания persistence trade-offs;

- понимания последствий async replication.

7. Пытаться решить все очереди, логи и события одним Redis

Redis умеет очереди и stream, но это не значит, что он автоматически заменяет:

- Kafka как event backbone;

- RabbitMQ как broker c routing semantics;

- специализированные persistent log systems.

Если требования начинают включать:

- долгую ретенцию;

- сложную маршрутизацию;

- replay;

- гарантии доставки и аудита;

стоит очень внимательно проверить, не тянете ли вы Redis туда, где нужен другой класс систем.

Что важно при подключении Redis-клиента

Для этой статьи полезнее не сами copy-paste примеры, а несколько общих правил, которые одинаково работают и для Go, и для Java, и для Rust.

Практически во всех языках базовые правила одинаковы:

- не открывать новое соединение на каждый запрос;

- настраивать timeout явно;

- заранее понимать, нужен ли pool / multiplexed connection / async client;

- сразу продумывать поведение при timeout и reconnect.

Сам выбор конкретной библиотеки обычно выглядит так:

- для Go —

go-redis; - для Java —

LettuceилиJedis, в зависимости от модели приложения; - для Rust —

redis-rs.

Но это уже скорее следующая практическая тема. Подробные примеры подключения из Go, Java и Rust лучше разбирать отдельно, вместе с pool, timeout, reconnect, Sentinel/Cluster-awareness и поведением клиента под деградацией. Иначе эта статья быстро превращается не в материал про Redis, а в разбор трёх SDK сразу.

TTL, память и вытеснение: важные особенности Redis

Именно здесь Redis часто недооценивают. На словах всё звучит просто: “положим данные в память, зададим TTL, а если что-то не влезет, Redis сам вытеснит”. На практике у каждой из этих идей есть цена и ограничения.

TTL очень полезен, но он не бесплатен

TTL в Redis обычно применяют к ключу целиком через EXPIRE / PEXPIRE. Это работает независимо от типа значения: строка, список, множество, hash, sorted set. Важный нюанс из документации: TTL снимается, когда ключ удаляют или перезаписывают новым значением, но операции, которые меняют значение “на месте”, обычно его сохраняют. Например, INCR, LPUSH и HSET не сбрасывают уже установленный TTL на ключе.

Практически это удобно, но есть несколько тонких мест:

- TTL требует дополнительной metadata и дополнительной работы со стороны Redis;

- удаление просроченных ключей происходит не только “по запросу”, но и активным фоновым циклом;

- одинаковая модель данных с TTL и без TTL — это не одна и та же цена по памяти и фоновым операциям.

По официальной документации Redis использует две модели expiration:

- passive expiration — просроченный ключ удаляется, когда к нему обращаются;

- active expiration — Redis регулярно сам просматривает часть ключей с TTL и очищает уже просроченные.

Для большинства нормальных workload это не проблема. Но если ключей с TTL очень много, а срок жизни у них короткий, у Redis появляется дополнительная работа, которой не было бы в таком же keyspace без expiration. То есть TTL — это не “бесплатная магия”, а полезный механизм со своей ценой.

Какая точность у TTL

С точки зрения точности Redis давно достаточно хорош: начиная с Redis 2.6 ошибка expiration лежит в диапазоне от 0 до 1 миллисекунды. Это хороший рабочий ориентир, если вам нужен TTL как часть rate limit, token expiration или short-lived cache.

Но это не значит, что Redis надо воспринимать как real-time scheduler. TTL отлично подходит для “эти данные должны жить примерно столько-то” или “после этого окна ключ должен исчезнуть”, но не для сценариев, где критична жёсткая и детерминированная точка исполнения бизнес-логики.

TTL можно вешать не только на ключ, но и на поля hash

Это особенно полезно в новых версиях Redis. Начиная с Redis Open Source 7.4, у Redis появились HEXPIRE, HPEXPIRE, HTTL и родственные команды: они позволяют задавать TTL отдельным полям внутри hash.

Это полезно, когда:

- вы храните связанную структуру в одном hash;

- хотите, чтобы одни поля жили дольше, а другие истекали раньше;

- не хотите разносить каждое поле в отдельный ключ только ради expiration.

Но здесь важно помнить ту же мысль: чем сложнее модель expiration, тем внимательнее нужно относиться к operational cost и к тому, как это выглядит в коде и monitoring.

Redis живёт ровно в той памяти, которая у него есть

Главный ресурс Redis — RAM. Если рабочий набор не помещается в память, у вас есть только несколько вариантов:

- уменьшать размер значений и общий cardinality;

- задавать TTL и очищать временные данные;

- включать осознанную eviction policy;

- шардировать данные;

- или признать, что Redis в этом сценарии вообще не лучший выбор.

Именно поэтому в Redis особенно важны:

- размер одного значения;

- количество ключей;

- доля временных и постоянных данных;

- hot keys;

- growth profile во времени.

Фраза “ну это же просто кэш” обычно заканчивается плохо ровно потому, что про память начинают думать слишком поздно.

maxmemory и eviction — это часть дизайна, а не тюнинг на потом

Redis позволяет ограничить память через maxmemory и выбрать политику вытеснения через maxmemory-policy.

Типовые политики:

noeviction— ничего не вытесняем, новые write-команды начинают получать ошибки при превышении лимита;allkeys-lru/allkeys-lfu— вытесняем любые ключи по приближённой модели LRU/LFU;volatile-lru/volatile-lfu— вытесняем только ключи, у которых есть TTL;allkeys-randomи другие менее частые варианты.

Из этого следуют важные практические выводы:

- если у вас смесь важного состояния и кэша в одном Redis, policy легко начинает бить не по тем данным;

volatile-*вообще не поможет, если часть временных данных хранится без TTL;noevictionне значит “Redis будет просто стоять на месте” — это значит, что приложение начнёт получать ошибки записи под давлением памяти.

Отдельный нюанс из документации: maxmemory — это не магическая гарантия, что Redis никогда не выйдет за этот объём used memory. Под нагрузкой, с replication или persistence фактическое потребление памяти может быть выше. Поэтому память надо проектировать с запасом, а не “ровно по лимиту”.

Что обычно лучше делать на практике

Если Redis нужен как cache или short-lived state, самый здоровый baseline обычно такой:

- хранить меньшие значения;

- явно задавать TTL там, где данные действительно временные;

- держать

maxmemoryи eviction policy как часть архитектурного решения; - не смешивать без необходимости критичное состояние и disposable cache;

- следить за ростом памяти, hit ratio, expired/evicted keys и hot keys.

Если данные стабильно не помещаются в память одного узла даже после нормализации размера значений и retention, следующий шаг — не “пожить ещё немного на одном Redis”, а либо шардирование через Redis Cluster, либо пересмотр самого решения.

Latency, throughput и размеры данных: какие порядки величин ожидать

Здесь важно не переобещать. У Redis нет одной “типовой скорости” вне контекста:

- сети;

- payload size;

- числа round-trip;

- pipelining;

- persistence;

- репликации;

- command mix;

- нагрузки на CPU и память.

Но инженерные ориентиры всё же есть.

Latency

Официальная документация Redis пишет, что собственная processing time обычно очень низкая, вплоть до sub-microsecond, а реальную latency чаще формируют сеть, hypervisor, slow commands, fork, AOF и окружение.

Практически это обычно значит:

- локально и в хорошем окружении — порядок десятых долей миллисекунды до единиц миллисекунд на простой запрос;

- внутри одного DC / одной зоны — часто sub-ms или low-single-digit ms при нормальной сети и sane payloads;

- в виртуализированном или шумном окружении — хвосты latency могут резко расти уже без вины самого Redis.

Это не SLA и не benchmark, а рабочий ориентир. Redis может быть очень быстрым, но он не отменяет RTT и плохую инфраструктуру.

Throughput

Для простых команд Redis способен обслуживать очень высокий поток запросов, а pipelining заметно увеличивает эффективность за счёт сокращения RTT.

Практический ориентир здесь такой:

- десятки тысяч ops/s — совсем не предел;

- сотни тысяч ops/s на узел — реалистичный порядок величин для простых команд при хорошем окружении;

- дальше всё начинает очень зависеть от pipelining, размера value, числа клиентов, persistence, replication и hot keys.

Если в design review кто-то называет одну красивую цифру throughput без контекста команд, payload и сети, это почти наверняка бесполезная цифра.

Размеры данных

Redis — память. Поэтому смотреть нужно не только на количество ключей, но и на:

- размер ключей;

- размер значений;

- overhead структур;

- фрагментацию памяти;

- наличие реплик;

- запас под fork / background rewrite.

Хороший практический baseline:

- мелкие значения и компактные структуры — отлично;

- объекты размером в килобайты — нормально, если access pattern это оправдывает;

- большие JSON/blob-значения на сотни килобайт и мегабайты — тревожный сигнал.

Если вам нужен Redis для хранения больших документов, архивов, сырого response body или “просто положим сюда результат на 5 МБ”, почти всегда стоит остановиться и пересмотреть дизайн.

Надёжность, persistence, failover и масштабирование

Один узел

Подходит для:

- локальной разработки;

- disposable cache;

- второстепенных функций, которые можно пережить без HA.

Не подходит, если Redis уже стал частью critical path и без него сервис реально не живёт.

Primary + replica + Sentinel

Это базовый путь для single-primary high availability.

Что важно:

- replication в Redis асинхронная;

- Sentinel умеет failover и service discovery;

- для robust deployment документация Redis рекомендует минимум три Sentinel-инстанса;

- клиенты должны уметь работать с Sentinel, это не “автоматически магия на сервере”.

То есть Sentinel — это не просто “включили HA”. Это ещё и:

- отдельные процессы;

- отдельная конфигурация;

- отдельная проверка поведения клиентов;

- понимание того, что acknowledged write при аварии всё равно может потеряться.

Cluster

Redis Cluster нужен не для “любой надёжности”, а прежде всего для масштабирования по данным и нагрузке через шардирование.

Cluster даёт:

- распределение slot-ов между узлами;

- горизонтальное масштабирование по ключам;

- встроенную кластерную модель, а не просто ручной sharding.

Но cluster приносит и свои ограничения:

- multi-key операции ограничены slot model;

- нужны cluster-aware клиенты;

- hot key никуда не девается, даже если шардов стало больше;

- operational complexity становится заметно выше.

Persistence: RDB, AOF и компромиссы

Официальная документация Redis прямо описывает trade-off между latency и durability.

Практически это выглядит так:

- без persistence — быстрее и проще, но пережить рестарт можно только как cold cache;

- RDB — снимки состояния, проще и дешевле, но возможна потеря последних изменений между snapshot;

- AOF everysec — частый компромисс между скоростью и durability;

- AOF always — надёжнее, но дороже по latency и I/O.

То есть вопрос “делаем ли persistence” нельзя решать привычкой. Он напрямую зависит от того, Redis у вас:

- disposable cache;

- важный session/state store;

- queue/stream tier;

- primary state for some business workflow.

Ограничения Redis, которые важно знать заранее

- Redis не отменяет сеть и RTT.

- Redis не бесплатен по RAM: память — основной ресурс и основная цена.

- Репликация асинхронная, значит “подтвердили запись” не всегда равно “никогда не потеряем”.

- Hot keys и big keys ломают красивые архитектурные схемы быстрее, чем кажется.

- Плохой выбор eviction policy и

maxmemoryбыстро превращается в неочевидную деградацию. - Cache invalidation и stampede никто не решит за вас автоматически.

- Если использовать Redis для очередей и stream, retention и cleanup нельзя оставлять “на потом”.

Отдельный operational нюанс: Redis очень чувствителен к качеству окружения. Документация отдельно предупреждает про virtualization noise, slow fork, transparent huge pages, disk I/O у AOF и slow commands. То есть даже “очень быстрый Redis” легко становится медленным, если базовая инфраструктурная дисциплина хромает.

Короткий checklist перед внедрением

Перед тем как говорить “добавим Redis”, полезно ответить на несколько вопросов:

- Это действительно cache, или вы добавляете новый stateful tier?

- Какой source of truth остаётся основным?

- Что делает система, если Redis недоступен?

- Как устроены TTL, invalidation и cold start?

- Какой expected key size, value size и cardinality?

- Какой policy по

maxmemoryи eviction? - Нужен ли просто один узел, Sentinel или уже Cluster?

- Что вы хотите от durability: cold cache, RDB, AOF everysec?

- Умеет ли выбранный клиент работать с вашей HA-моделью?

- Чем Redis в этом сценарии лучше PostgreSQL, локального in-process cache или другого broker/storage?

Если на эти вопросы нет ответов, Redis почти наверняка добавит больше проблем, чем пользы.

Итог

Redis — очень сильный инструмент, но только если использовать его по профилю. Он отлично работает как быстрый слой для горячих данных, counters, TTL-driven state, session store, rate limiting, ranking и некоторых очередных сценариев. Но он плохо переносит расплывчатую формулировку “поставим кэш и станет быстрее”.

Инженерный взгляд на Redis обычно спокойнее:

- это не “магическое ускорение”;

- это не автоматическая замена основной БД;

- это не бесплатная надёжность;

- это отдельный stateful компонент с собственными trade-offs.

Если относиться к Redis именно так, он часто даёт очень хороший результат. Если относиться к нему как к волшебной таблетке, он быстро превращается в источник latency spikes, memory pressure и неприятных архитектурных сюрпризов.

В следующей статье разберём подключение к Redis из Go, Java и Rust — пулы, таймауты, retry и типичные ошибки клиентских библиотек.

Документация и первоисточники

Для этой статьи я опирался в первую очередь на официальные материалы Redis:

- Redis Open Source: get started

- Redis as an in-memory data structure store

- EXPIRE

- Latency generated by expires

- Hash field expiration (

HEXPIRE,HTTL) - Redis pipelining

- Diagnosing latency issues

- Memory optimization

- Key eviction

- Redis persistence

- Redis replication

- High availability with Redis Sentinel

- Scale with Redis Cluster

- Go client guide (

go-redis) - Java client guide (

Lettuce) - Rust client guide (

redis-rs)

Где я говорю о “порядке величин” по latency, throughput и размерам, это не обещание конкретных цифр из docs, а инженерная интерпретация и практический ориентир, который всегда нужно проверять на своих workload, сети, persistence и payload size.

Комментарии